Categoría: Internet

NNTs y Mednar

El NNT o número necesario a tratar es el reciproco de la Reducción de Riesgo absoluto, es un valor o indicador específico para cada tratamiento. Describe la diferencia entre un tratamiento activo y un control (placebo u otro tratamiento) en lo que se refiere a lograr un resultado clínico concreto (Wikipedia).

Hay personas que piensan que el NNT es un poderos metodo para mostar las difrencias que consigue un tratamiento, asi como para comparar la eficacia de diversos tratamientos y el esfuerzo que hay que conseguir para lograr un determiando efecto. Por esa razon publican esta completa página llena de buenos recursos y mejor información- The NNTs. Ensus propia palabras:

Hay una forma de entender lo que la medicina moderna tiene que ofrecer a los pacientes individuales. Hay un simple concepto en estadística llamado el «número necesario a tratar», o, para abreviar el ‘NNT. El NNT ofrece una medición del impacto de un medicamento o tratamiento mediante la estimación del número de pacientes que necesitan ser tratados con el fin de obtener un impacto en una persona. El concepto es estadístico, pero intuitivo, ya que sabemos que no todo el mundo se beneficia de una medicina o intervención – algunos se benefician, algunos se ven perjudicados, y algunos no se ven afectados. El NNT nos dice cuántos hay de cada uno.

Mednar es un buscador especial que utiliza otros motores de búsqueda para obtener resultados de alta calidad. Los presenta prácticamente en tiempo real una vez que ha recopilado, clasificado y omitido los duplicados

Customizado

Incluso mucho antes de escribir esta entrada (que colateralmente provoco un malentendido con unos divertidos bibliotecarios) teníamos en mente la importancia de desarrollar buscadores específicos que recogieran las indudable virtudes de Google obviando algunos de sus problemas como la exhaustividad y heterogeneidad del información encontrada.

El mismo Google aporto la solución con Google custom search o búsqueda personalizada de Google. Un servicio, en constante y continuo desarrollo, que permite crear un buscador con toda la potencia y rapidez de este motor de búsqueda, pero donde el usuario selecciona las direcciones y contenidos en los que se busca. En lugar de buscar en múltiples sitios, Google busca en los lugares especificados con resultados más concretos y ajustados a las necesidades del que lo usa. Una vez creado se puede compartir con otros usuarios, insertarlo en una página web, en un blog, página de inicio, etc.

De la gran cantidad y variedad de Googles personalizados que se han creado desde su puesta en marcha da idea esta página donde se ven en la obligación de indizar el importante número de Google custom searchs diseminados por la red. En salud y medicina como no podía ser menos también se han creado este tipo de herramientas y tenemos excelentes ejemplos como el imprescindible buscador de información fármaco-terapéutica desarrollado por Ernesto Barrera (y que desde hace años he vampirizado para mi página de medicamentos) o los buscadores pediátricos de los chicos del GIPI, los buscadores del blog Pediatría basada en la evidencia y los de la semfyc. Incluso uno de ellos, Alquimia “ha salido” en una revista científica.

El último de los conocidos, es el buscador Informapacientes creado por un grupo de médicos de la sanidad pública en la comunidad de Murcia interesados en el tema de la información y la educación sanitaria. Han diseñado un buscador de información sobre salud dedicado a los pacientes y cuyo objetivo es ofrecer un buscador de información sanitaria que permita resolver dudas de forma fácil y fiable, evitando aquella información demasiado especializada (para profesionales), no contrastada o interesada.

«Operar de la vena aorta», ¡miralo por internet

Tratar un aneurisma de aorta, aunque sea con endoprótesis vascular no es una cosa baladí , y menos para el paciente. Me imagino que la mayoría de las personas que van a ser tratados de esta enfermedad han buscado, o alguien lo ha hecho por ellas, información en Internet.

¿ y que encuentran?

La Revista Española de Cardiología que es con toda probabilidad la mejor revista científico- médica de España, con el valor añadido de una rotunda y temprana presencia en Internet, publica (ra) un articulo donde una vez más se pretende evaluar la calidad de la información médica presente en la red , en este caso el aneurisma de aorta y su tratamiento endovascular mediante la implantación de endoprotesis. El aporte original de los autores y su articulo es que no se limitan a determinar parámetros «clasicos» como la calidad- fiabilidad de la información disponible, en base a unos criterios más o menos definidos o exactos como hacen la mayoría de estudios que se han publicado sobre el tema

tomada de http://saludcomunitaria.wordpress.com/

Los autores consideran también importante medir la legibilidad de los documentos encontrados. Se entiende por legibilidad como el conjunto de características de los textos que permiten ser comprendidos en mayor o menor grado por los lectores. Se puede distinguir una legibilidad tipográfica y una legibilidad lingüística relacionada con la comprensión. De ahí que algunos autores hablen de compresibilidad y deje el genérico de legibilidad para el objeto material en la que se encuentra el texto y que en el caso de Internet será de la página web que lo alberga, entroncado con conceptos como la usabilidad, diseño web, etc.

¿Que hicieron los autores?,

pues buscar con los términos «aneurisma de aorta» y «endoprótesis de aorta» en Google, Yahoo y MSN/Bing, en idioma español y recopilar las primeras 30 páginas web obtenidas por estos buscadores. En cada página se evaluó la legibilidad del texto, con formulas objetivas para el análisis de la legibilidad lingüística, desarrolladas sobre todo para la lengua inglesa, así como diferentes utilidades o aplicaciones informáticas, que calculan los parámetros e índices utilizado en la evaluación de esta propiedad. En general, la mayoría de las formulas de legibilidad parten de la hipótesis de que un texto es tanto más fácil de leer cuanto más cortas son las palabras y frases que utiliza.

Para valorar otras características de la información que pudieran conformar la calidad de esta, tales como la utilidad y fiabilidad, los autores eligieron, dentro de la gran cantidad de alternativas propuestas y publicadas, la herramienta conocida como LIDA por considerarla validada en estas áreas y además contemplar la accesibilidad.

De forma genérica (los resultados son prolijos y un resumen breve es difícil por la necesidad de repasar los diferentes instrumentos de medida utilizados) se puede decir, con la conclusión del estudio, que la información disponible en Internet sobre términos de patología cardiovascular, como el aneurisma de aorta y el tratamiento con endoprótesis, presenta deficiencias en cuanto a accesibilidad, utilidad y fiabilidad, con la deficiencia añadida de una difícil legibilidad.

Además hay que resaltar (los autores pasan de puntillas sobre el tema) la vergonzosa escasez de páginas institucionales o de sociedades científicas encontradas (ninguna). Como en otros estudios similares realizados en nuestro país, las instituciones que en teoría podrían ofrecer información de mejor calidad, brillan por su ausencia. Que por ejemplo, el primer resultado en Google, sea una clínica privada de ámbito provincial, da mucho que pensar sobre la importancia que las instituciones sanitarias dan a la información para pacientes en Internet.

Se acompaña de un editorial de Francisco Lupiañez experto de los de verdad en información e internet. Algo denso para mi gusto, pero que enmarca muy bien el tema y del cual destaco dos frases:

- “Dada la imposibilidad de controlar la información en internet, por la propia naturaleza de este medio, cualquier medida de control de la calidad estará´ abocada al fracaso”

- “El uso de internet no se puede aislar del contexto organizativo, social y cultural; por lo tanto, habrá tensiones que faciliten o inhiban tanto su utilización como su impacto, negativo o positivo”

Desidia PDF

Como parece que no se ha entendido muy bien – mea culpa- el post anterior sobre los PDFs voy a intentar explicar el porqué no se deben utilizar los PDFs y sobre todo las causa de mi diatriba.

Alberto Knapp lo cuenta muy gráficamente en una de sus charlas.

Alberto Knapp lo cuenta muy gráficamente en una de sus charlas.

Cada vez que surge una nueva tecnología, esta intenta imitar en su funcionamiento y proceso a la tecnología de la que es heredera. Se piensa y se usa esta nueva tecnología en términos de la tecnología anterior.

Como ejemplo los primeros coches a motor diseñados con una estética y materiales (madera) similares a los de los coches de caballos a los que precedieron. Es más, no sé si habrá fijado que estos coches iniciales eran coches sin techo. Aunque los conductores de estos nuevos carruajes no necesitaran blandir el látigo para espolear a los caballos, persistía la idea de que los coches debían ser descubiertos, al menos la zona reservada al conductor. Analogías similares encontramos en las primeras películas que no eran más que meras traslaciones del teatro a la pantalla, la invención de la telegrafía, el teléfono, la radio, o la televisión.

Una vez que la nueva tecnología evoluciona y desarrolla sus propios procesos empieza a mostrar sus posibilidades que serán nuevas y distintas de las que se hacían anteriormente.

Si la representación intelectual que nos hacemos sobre la información y el conocimiento son las páginas de un libro o de una revista académica, nos sentiremos cómodos cuando tengamos delante de nosotros esas páginas, o lo más parecido a ellas: el formato PDF. Muchas personas se encuentran todavía en este estadio, para ellos Internet tiene indudables ventajas, pero la siguen viendo como un inmenso almacén donde colocar y conseguir información, eso sí en un formato confortable y familiar: el PDF, como la telegrafía sin hilos o como un coche sin techo.

Pero las cosas han cambiado y no reconocerlo es peligroso, Internet, ya cuenta con espacios nuevos como las redes sociales o los blogs, la información es ubicua sin que sepamos muchas veces su verdadero origen y se comparte y actualiza automáticamente y a extraordinaria velocidad. En Internet la audiencia es a la vez productora de información, hay un nuevo tipo de mensaje que ya no requiere una estructura estandarizada, ni siquiera de un lenguaje uniforme. En estos casos anclarse en formatos antiguos y poco prácticos, es como esos primeros usuarios de la televisión que “encendían” la tele sin abrir las puertas, porque ellos, a lo que estaba acostumbrados era a oír la radio.

Con otro enfoque Rafa Cofiño en su blog llega conclusiones parecidas a las mías e un impagable post titulado Diario de un procastinador.

PDFs ¡NO gracias!

Insistimos NO ultilice PDFs

En tecnología, como en otros órdenes de la vida, el hallazgo de soluciones intermedias que solventan con decoro un problema, constituye un atraso en tanto en cuanto impiden seguir esforzándose en encontrar una solución definitiva, que resuelva totalmente el asunto.

Negroponte autor de “El mundo digital” utiliza el fax como paradigma de estas soluciones intermedias. Según él, el fax fue (es) una gran mancha en el paisaje de la información, un paso atrás cuyas consecuencias padeceremos durante mucho tiempo. El fax encajo muy bien en la cultura japonesa que está muy orientada a la imagen, también en la administración pública donde es muy difícil librarse práctica y conceptualmente de la tiranía del papel. El fax elimina la legibilidad por ordenador, que es el medio ideal por el cual el destinatario puede almacenar, recuperar y manipular automáticamente nuestro mensaje, su uso masivo- el del fax-aunque aparentemente ventajoso, frenó y frena el desarrollo de alternativas más eficientes en la comunicación.Por ejemplo el correo electrónico mediante el cual se pueden enviar una página para que el destinatario la imprima, pero tambien para que se almacene la información que contiene, o se modifique según se desee o necesite. Con el fax esto es imposible, y ni siquiera es más económico.

Algo parecido ha sucedido con el formato de archivo PDF (Portable Document Format) en Internet, utilidad informática casi tan odiosa y odiable como la tipografía Comic Sans. La indudable utilidad del PDF (de hecho el libro de Negroponte está en Internet en este formato) y sobre todo la familiaridad que nos transmite -es igual que nuestro querido papel- da como resultado una abusiva y torpe utilización.

Algo parecido ha sucedido con el formato de archivo PDF (Portable Document Format) en Internet, utilidad informática casi tan odiosa y odiable como la tipografía Comic Sans. La indudable utilidad del PDF (de hecho el libro de Negroponte está en Internet en este formato) y sobre todo la familiaridad que nos transmite -es igual que nuestro querido papel- da como resultado una abusiva y torpe utilización.

Aunque a algunos les cueste creerlo colgar un documento PDF que pueda/deba imprimir (se) no es producir información en Internet, de igual manera enviar datos, no es adjuntar un PDF. Con los datos e información en formato PDF obligamos al usuario que salga de su navegador, interrumpimos y enlentecemos su singladura por la web y empaquetamos la información en un rígido corsé

El PDF es ideal para una cosa y sólo una cosa: la impresión de documentos.

Por tanto, recuerda: sirve para lo que sirve, para documentos grandes que los usuarios descargan para su posterior impresión y consulta en papel. El papel sigue teniendo ventajas en algunas tareas y aquí es donde el PDF brilla ya que al fin y al cabo es un representación de los originales, a los que tanto estamos acostumbrados. Para publicar en línea, como se hace a menudo, un folleto, un programa, un informe o un artículo científico, una monografía o un manual breve como un solo archivo, PDF es un despropósito y un atentado contra dos propiedades sagradas de Internet la usabiidad y el flujo libre y rápido de información.

De acuerdo, muchos usuarios prefieren imprimir los documentos largos para leerlos más fácilment, ademas más vale eso que nada ¿ no?

Pues no, porque la aparente ventaja se volverá tarde o temprano en contra nuestra, si consideramos Internet como un almacén de PDFs nunca podremos entender lo que es la Web 2.0, ni los sucesivos avances que se están produciendo. Si nuestras ansias de información se ven satisfechas con ese remedo de fotocopia digital que es el PDF, nunca podremos visualizar un mundo donde los datos fluyen en un espacio de información navegable, no se podrán alimentar las aplicaciones hibridas. Tampoco se podrá transformar la información, no conseguirá ser interactiva, no se podrá utilizar desde mil sitos y de mi maneras con diferentes objetivos y sobre todo de manera eficaz y barata.

web 2.0: incubando ideas (I)

Best practice

Hace más de dos años dedicabamos una entrada a un recurso de información bastante útil en atención primaria Best Practice del grupo editorial BMJ, hoy la recordamos por haber sido adquirido recientemente por la Agencia Lain Entralgo y por tanto estar disponible para todos los profesionales de la Comunidad de Madrid.

Si uno busca Best Practice en Google encuentra, entre otros enlaces, un programa informático que permite modificar la velocidad de reproducción de una canción, ideal para poder escribir cómodamente la laetra de la canción, o también para poder comprender fácilmente lo que dicen, si no se entiende bien a su velocidad normal, además de poder reconocer mejor los sonidos de los instrumentos que aparecen.

Si uno busca Best Practice en Google encuentra, entre otros enlaces, un programa informático que permite modificar la velocidad de reproducción de una canción, ideal para poder escribir cómodamente la laetra de la canción, o también para poder comprender fácilmente lo que dicen, si no se entiende bien a su velocidad normal, además de poder reconocer mejor los sonidos de los instrumentos que aparecen.

Siguiendo el concepto se puede hacer una analogía con un recurso de información lanzado por el BMJ Publishing Group, llamado Best Practice , una fuente de información de los denominadas de información en la consulta (point of care) localizado en el estrato más alto de la pirámide de Haynes. Contiene varias fuentes de información dedicadas a favorecer la toma de decisiones no solo en relación con cuestiones de tratamiento como es habitual, sino también en relación con la prevención, manejo, diagnóstico, pronóstico, etc de las diferentes enfermedades. La información se presenta de forma uniforme bajo y una misma interfaz, resumida y estructurada de tal forma que permita un acceso rápido- de un vistazo-. Sería como si ralentizáramos y adaptáramos la información científico-medica para poder entenderla y aprovecharla mejor en un entorno, la consulta medica, donde la rapidez y la facilidad de uso es primordial, sin olvidar la relevancia y la validez.

el busca, nosotros encontramos

Dentro de las múltiples aplicaciones prácticas de Google se encuentra la generación de información a partir del comportamiento de los usuarios de este famoso motor de búsqueda. Si se asume que mientras más importante sea un fenómeno, habrá más posibilidad de que alguien busque información al respecto, la cantidad de personas que buscan sobre algo podría estar relacionada con la importancia de este fenómeno. Si podemos “contar” el número de veces que se busca un determinado termino podremos presentir su importancia (relativa) y relaciónalo con otros sucesos o datos. Sería (es) una especie de sabiduría de las masas en las que los individuos aportan su opinión con el simple hecho de introducir un término en el buscador.

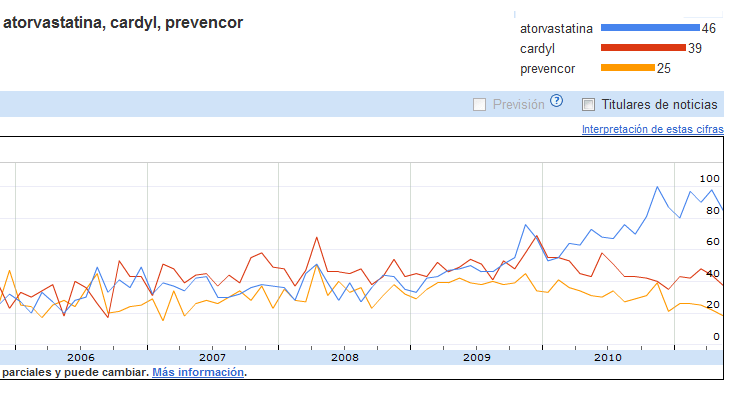

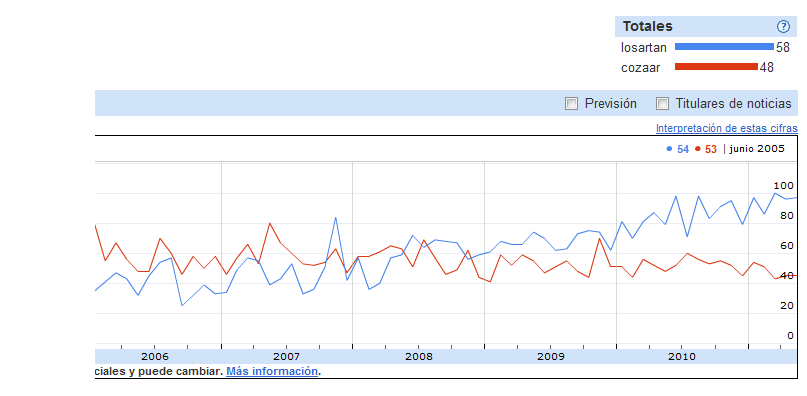

El comportamiento de búsqueda de miles de usuarios en Google para obtener información sobre salud ha permitido conocer de forma dinámica y prácticamente en tiempo real, la incidencia de la gripe y otras enfermedades infecciosas, incluso en España o en problemas psiquiátricos como el suicidio o la depresión . De igual forma en un artículo publicado por la revista American Journal of Managed Care titulado Using Search Engine Query Data to Track Pharmaceutical Utilization: A Study of Statins se intenta averiguar si la búsqueda de información en Google se puede utilizar para indagar las tendencias de utilización de medicamentos farmacéuticos en un determinado periodo y si esta tendencia se asocia con los ingresos por estos y con la utilización de servicios sanitarios.

Los autores parten de la tesis de que, como en otros ejemplos, las búsquedas en Google se correlacionan con el consumo de esos medicamentos y la utilización del sistema sanitario, ya que los pacientes consultan Internet para obtener información relacionada con la salud. En particular, ensayan la posibilidad de que cambios en la utilización de medicamentos se puedan reflejar en las búsquedas de Google y más específicamente cuando se producen cambios de la protección de la patente y la aparición de alternativas genéricas de menor costo. Para probar esta tesis se tomo como ejemplo búsquedas en Google sobre medicamentos para reducir el colesterol como las estatinas

Se evaluaron las tendencias temporales de búsqueda en Google-búsqueda personalizada de los términos Lipitor (nombre comercial en USA de artovastatina Pfizer) y simvastatina y se relaciono con los ingresos anuales por estos medicamentos, y la utilización de recursos sanitarios, medida por el uso de servicios de la comunidad de beneficiarios de Medicare.

El número de consultas en Google para Lipitor se redujo significativamente desde enero de 2004 hasta junio de 2009 , mientras que el número de consultas para simvastatina aumentó en el mismo periodo de tiempo, con un cambio significativo en las tendencias para las consultas de ambos cuando se produjo el cambio de patente de la simvastatina. Además la caída de las búsquedas de Lipitor se correlaciono con la variación porcentual de los ingresos por Lipitor. Utilizando un modelo de regresión se vio que por cada aumento del 1% en la utilización de los servicios de Medicare en una comunidad, se produjo un aumento de 0,2 en la relación de consultas en Google de Lipitor sobre simvastatina.

Los autores concluyen que la demanda de información mediante consulta en motores de internet que ponen a nuestra disposición la estadísticas de millones de búsquedas, proporcionan una fuente de datos en tiempo real sobre las tendencias de utilización de medicamentos, con la posibilidad de informar a pacientes, profesionales, gestores y responsables políticos.

También se comenta en el artículo que usos futuros de esta especie de caza de tendencias que son los estudios con las estadísticas de Google, podrían incluir otras funciones como la cartografía de la utilización de productos farmacéuticos, o el de seguimiento en tiempo real de la reacciones a los cambios de política y ajustes de precios incluso la predicción de la demanda de servicios de salud.

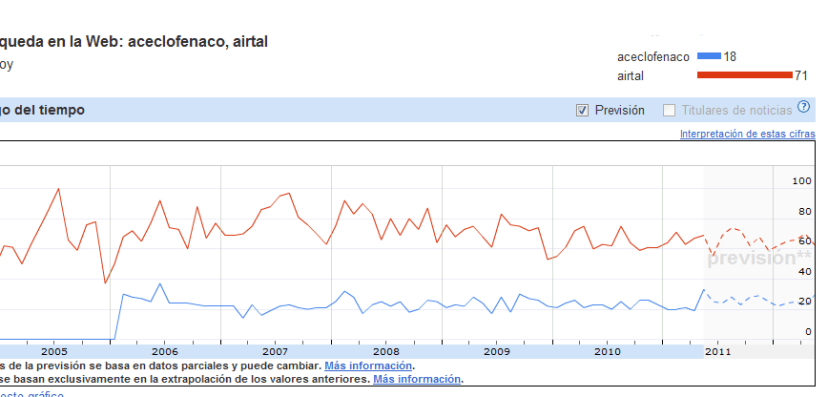

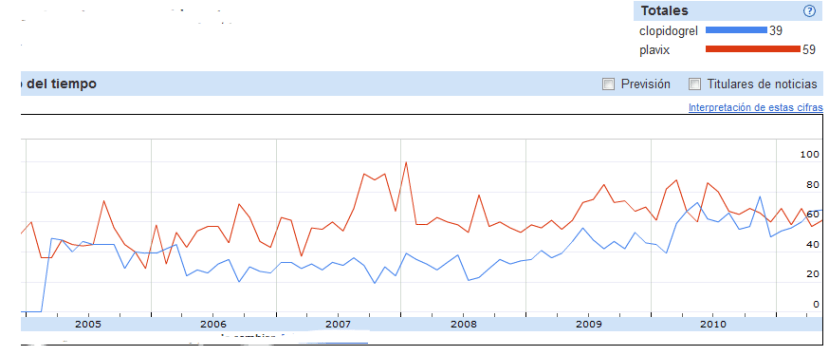

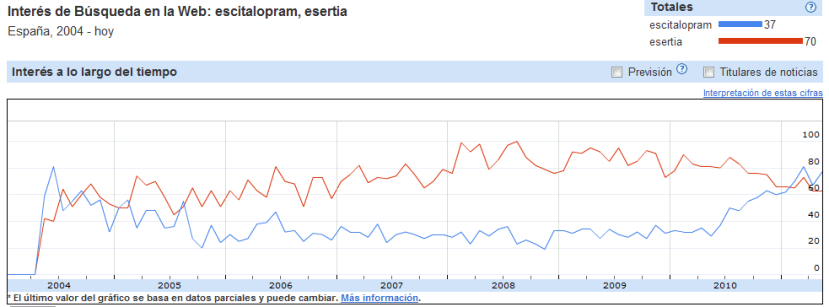

Para probar esta posibilidad he realizado unas búsquedas utilizando fármacos a los que ha caducado la patente y por tanto tiene su correlato genérico en el mercado español y algunos que han sido objeto de medidas de sustitución forzada por parte de algunas autoridades autonómicas. Es interesante comprobar el paso de nombre comercial a genérico Sería bueno ver la correlación con el gasto por estos medicamentos y anotar la fecha de salida del genérico, pero eso ya lleva mucho trabajo y lo dejo para los expertos

el verdadero valor de las redes sociales en medicina (III)

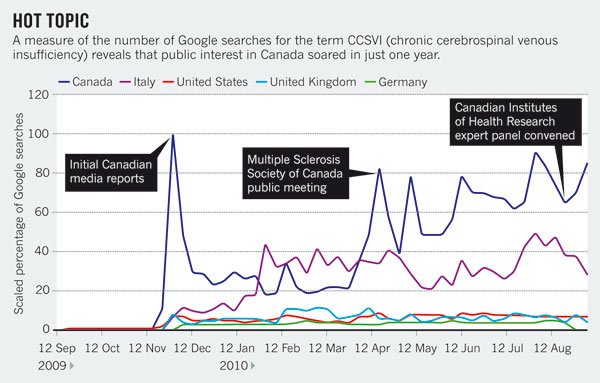

La misma semana que el artículo de PatientsLikeMe, y también reseñando por El Mundo, se publico en Nature la historia de una polémica sobre la supuesta curación de la Esclerosis múltiple por el Dr Zamboni y que ha tenido como protagonista secundario las redes sociales de pacientes. Protagonistas en este caso de una historia algo turbia y sin final feliz. Más bien la historia de la difusión y reivindicación de un posible engaño como prueba de que la herramienta es tan tonta o lista como puede ser la gente que la utiliza, podriamos hablar incluso de “ ingenuidad de las multitudes” en contraposición al Wisdom of Crowds.

El doctor Paolo Zamboni, cirujano vascular de la Universidad de Ferrara, Italia, piensa que la mayoría de los casos de esclerosis múltiple (EM) están originados por un estenosis de las venas del cerebro . La llamada por él insuficiencia venosa cerebroespinal crónica –CCSVI es su acrónimo en inglés-, sería la causa de la esclerosis múltiple al provocar que el hierro de la sangre se escape hacia el tejido cerebral provocando los daños característicos de la EM. La etiología de esta enfermedad seria vascular y no inmunológica como piensan la mayoría de los investigadores, y el tratamiento sería quirúrgico con una técnica es similar a la de las angioplastias habituales, aunque él lo denomina “procedimiento de liberación”, y parece que con éxito, según el artículo que publico hace un año en la revista Journal of Vascular Surgery.

El doctor Paolo Zamboni, cirujano vascular de la Universidad de Ferrara, Italia, piensa que la mayoría de los casos de esclerosis múltiple (EM) están originados por un estenosis de las venas del cerebro . La llamada por él insuficiencia venosa cerebroespinal crónica –CCSVI es su acrónimo en inglés-, sería la causa de la esclerosis múltiple al provocar que el hierro de la sangre se escape hacia el tejido cerebral provocando los daños característicos de la EM. La etiología de esta enfermedad seria vascular y no inmunológica como piensan la mayoría de los investigadores, y el tratamiento sería quirúrgico con una técnica es similar a la de las angioplastias habituales, aunque él lo denomina “procedimiento de liberación”, y parece que con éxito, según el artículo que publico hace un año en la revista Journal of Vascular Surgery.

Como comenta Pascual Lozano en su blog: parte de la comunidad de especialistas en esclerosis múltiple se sintió atraído por esta teoría comenzando a realizar angioplastias venosas, aunque la gran mayoría se muestran muy escépticos y piensa que estos hallazgos (estenosis venosa) suponiendo que sean reales, son más la consecuencia que la causa de la esclerosis múltiple. Se piensa que para estar seguros de la teoría causal y del tratamiento se deberían diseñar un ensayo clínico riguroso, y en eso parece que esta el doctor Zamboni.

Mientras tanto los pacientes, afectos no lo olvidemos de una enfermedad terrible y sin cura, se agarran a esta esperanza de tratamiento y por un lado peregrinan a la clínica de Zamboni o a hospitales dónde se realiza esta técnica, y por otro lado se organizan para reclamar en su país de origen fondos y atención para este “milagroso” método de curación. Y aquí entran las redes sociales y el articulo con el adecuado nombre para estas fechas de The rise o people power y que da pie a este post. Se han creado multitud de blogs y grupos en Facebook de pacientes con la enfermedad que reclaman financiar con dinero público investigaciones y tratamientos basados en la hipótesis de la CCSVI.

La chispa ha prendido en muchos países- incluido España, pero es en Canadá donde este movimiento ha tomado una fuerza inusitada a pesar del hecho de que ni investigadores ni asociaciones de pacientes la defiendan.Iniciado por medios tradicionales como televisión y prensa, la campaña ha proseguido en las redes sociales con el objetivo de que se inicien estudios sobre el tema. Lo autores del artículo de Nature concluyen que los científicos deben tener muy en cuenta el papel de estos nuevos medios en la trasmisión de información científica al público, y de las formas de contrarrestarla en caso necesario, se podría añadir. El poder movilizador de las herramientas de la web 2.0 queda manifiesto una vez más, aunque en este caso la causa pueda no ser tan digna del esfuerzo. como es el caso de alterar las prioridades y fondos de la investigación.

el verdadero valor de las redes sociales en medicina (II)

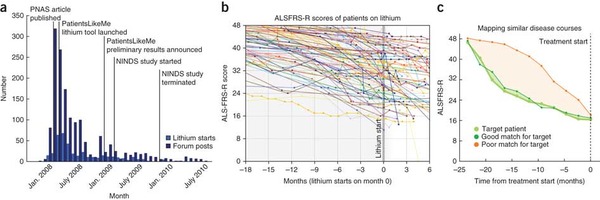

Los responsables de patientslikeme además de conectar a miles de pacientes con diversas enfermedades, desde hace tiempo intentan generar conocimiento relacionado con estas. También es interesante y digno de comentar en otro post su peculiar y avanzada forma de abordar el problema de la privacidad de los datos, radicalmente diferente de las normas al uso.

En el artículo citado se utilizo esta red social para evaluar un tratamiento en una determinada población. En concreto el carbonato de litio para la esclerosis lateral amiotrofica (ELA), que aunque no estaba indicado como tal para esa enfermedad se estaba utilizando tras los resultados de un esperanzador estudio preliminar. El título del artículo ya es revelador de las intenciones y resultados del estudio: Descubrimiento acelerado de información clínica con datos de recogidos por los propios pacientes e informados en línea y un algoritmo de emparejamiento de pacientes. – Accelerated clinical discovery using self-reported patient data collected online and a patient-matching algorithm–

Tras la publicación del pequeño ensayo clínico inicial, los responsables de patientslikeme recogieron los datos de los pacientes con ELA registrados en esta red que estaban tomando carbonato de litio por indicación de su médico y diseñaron un cuestionario que recogía los resultados proporcionados por ellos mismos en función de una escala específica. En esta red se disponía de información relativa a más de cuatro mil pacientes con ELA de los cuales 348 tomaban carbonato de litio. De este grupo, y tras aplicar los criterios de inclusión y exclusión se incluyeron los datos de 149 en el análisis observacional. Para obviar en lo posible los sesgos derivados de la no aleatorización, se desarrolló un algoritmo que relacionó los datos de estos pacientes con los de 447 controles, en función de la progresión de la enfermedad.

Aunque el tipo de diseño observacional, la falta de aleatorización y cegamiento no se corresponda con el diseño deseable para probar eficacia, lo datos tras un seguimiento de un año los datos confirmaron los resultados de otros estudios que se habían publicado en el interregno. El litio no modificaba la progresión de la enfermedad medida mediante la escala de evaluación funcional de la ELA (Amyotrophic Lateral Sclerosis Functional Rating Scale).

Aunque el tipo de diseño observacional, la falta de aleatorización y cegamiento no se corresponda con el diseño deseable para probar eficacia, lo datos tras un seguimiento de un año los datos confirmaron los resultados de otros estudios que se habían publicado en el interregno. El litio no modificaba la progresión de la enfermedad medida mediante la escala de evaluación funcional de la ELA (Amyotrophic Lateral Sclerosis Functional Rating Scale).

Pero lo novedoso de este estudio no es la refutación o no de una hipótesis previa sobre la eficacia de un tratamiento. Lo verdaderamente importante es que esta experiencia y alguna previa permite afirmar a los autores que la recogida de información de los propios pacientes a través de las redes sociales es una opción viable, rápida y económica que puede complementar los resultados de los ensayos clínicos controlados. Los datos notificados por los pacientes a través de Internet de forma rápida (se tardo menos de nueve meses desde que se diseño el cuestionario de recogida y se obtuvieron los primeros datos) y poco costosa acelera el descubrimiento de información clínica y pueden servir para la evaluación de la eficacia de medicamentos especialmente de los que ya están en uso.

Toda una revolución que pone al paciente y sus experiencias no ya en el centro de la atención sanitaria, sino de la propia investigación biomédica.

La experiencias de esta red social y otras como Cure Toghether (recopilación de síntomas y clasificación de medidas preventivas y terapéuticas) o Ask a Patient (información sobre la eficacia y seguridad de medicamentos informada por los propios pacientes) son el principio de algo prometedor que puede modificar para siempre la forma en la que se obtiene los datos no solo sobre la seguridad y eficacia de los tratamientos, sino también sobre las propias enfermedades, su forma de presentación, sus síntomas, su historia natural, su pronóstico, etc.